Architektur: Die Mechanik hinter der generativen KI

Um digitale Assistenten effektiv konfigurieren zu können, ist ein grundlegendes Verständnis der zugrundeliegenden Technologie – des sogenannten KI-Modells – förderlich.

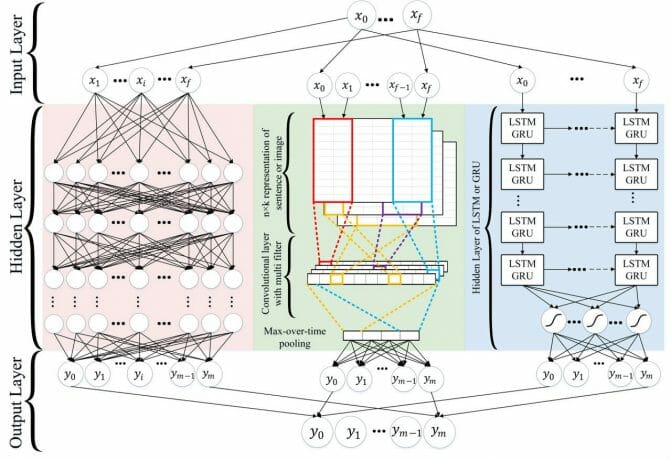

Ein KI-Modell fungiert nicht als klassische Datenbank, die Informationen einfach abruft. Es handelt sich um ein neuronales Netzwerk, das darauf trainiert wurde, Wahrscheinlichkeiten zu berechnen und Muster zu reproduzieren.

Der Trainingsprozess: Vom Algorithmus zum Assistenten

Moderne Modelle durchlaufen Trainingsphasen, die maßgeblich determinieren, welche Aufgaben später bewältigt werden können:

- Das Pre-Training (Mustererkennung): Das Modell analysiert massive Datenmengen (Bücher, Code-Repositories, Web-Archive). Dabei werden keine Fakten auswendig gelernt, sondern strukturelle und semantische Zusammenhänge. Es erlernt Grammatik, Programmierlogik und Domänenwissen.

- Fine-Tuning (Verhaltensanpassung): Durch spezifisches Training wird das Modell darauf konditioniert, auf Anweisungen ("Prompts") in einer strukturierten, hilfreichen Form zu reagieren.

- Inferenz (Anwendung): Wird eine Aufgabe gestellt, berechnet das Modell anhand der erlernten Muster das statistisch wahrscheinlichste und inhaltlich passendste Ergebnis (Token für Token).

Definition: Ein generatives KI-Modell ist ein stochastischer Algorithmus, der darauf trainiert wurde, komplexe kognitive Muster zu erkennen und auf Basis einer Eingabe synthetische Resultate zu erzeugen.

Spezialisierung der Modelle

Die Plattform bündelt verschiedene Architekturen, um ein breites Spektrum an Geschäftsprozessen abzudecken:

🧠

Language Models (LLMs)

Fokus auf Semantik. Analyse, Strukturierung und Generierung von Fließtext. Prädestiniert für Datenextraktion, Übersetzungen oder das Verfassen fachspezifischer Dokumentationen.

🎨

Diffusions-Architekturen

Fokus auf Visualisierung. Überführung von Texteingaben in vektor- oder pixelbasierte Bildstrukturen. Effizient für Layout-Skizzen und UI-Entwürfe.

💻

Code-spezifische Modelle

Fokus auf Logik. Verarbeitung strikter Syntax-Vorgaben von Programmiersprachen. Optimiert für Debugging, Refactoring und Skriptgenerierung.

Die Plattform als Orchestrator

Für die Anwendung entfällt die technische Notwendigkeit, Modellspezifikationen im Detail zu kennen.

Die Plattform fungiert als Orchestrator. Die benötigte Spezialisierung wird im Interface ausgewählt, die fachlichen Parameter werden definiert und das System routet die Anfrage an das passgenaue Modell.

So lassen sich komplexe, systemübergreifende Workflows ("Recherche -> Textgenerierung -> Code-Implementierung") abbilden, ohne tiefgehende Data-Science-Kenntnisse vorauszusetzen.